December 18,2021

Wgląd w zespół gaśniczy „Nauczyłem się przezwyciężać wstręt”

by Kolbowicz Marek

Przemoc i nienawiść w każdej sekundzie: Burcu Gültekin-Punsmann pracował nad postami na Facebooku w berlińskim zespole ds. usuwania. Mówi teraz o tym, co Facebook woli ukrywać.

Przez trzy miesiące Burcu Gültekin-Punsmann przeglądał posty zgłaszane przez użytkowników dla dostawcy usług Facebooka Arvato w Berlinie. Widziała straszne zdjęcia i filmy, które zaczęły się pojawiać. Słyszała, jak koledzy mówią, że teraz nigdy nie chcą mieć dzieci. Uważa, że świat powinien o tym wiedzieć i więcej o tym mówić. Rozmawiała z t-online.de o tym, dlaczego upubliczniła się.

Wystawiłeś umowę o zachowaniu poufności. O co mogę cię zapytać?

Mogę opowiedzieć o tym, jak się czułem, jakie były największe wyzwania i co mi zrobiła praca. I cieszę się, kiedy wychodzi publicznie. Myślę, że ważne jest, aby przekazać to, co widziałem i czego doświadczyłem. To, o czym nie będę mówił, to zasady, czyli zbiór zasad postępowania z wiadomościami w zespole przeciwpożarowym. Powinni o tym mówić osoby, które są z nią związane od dawna i odpowiadają za to na Facebooku.

Ale można powiedzieć, że zasady zmieniały się kilka razy?

Tak, i to też jest całkiem normalne. Szybko reaguje na zmiany. Odkąd wyjechałem na początku listopada, być może trochę to zmienili - a może wcale.

Burcu Gültekin-Punsmann ma 42 lata, jest Turkiem i żonaty z Niemcem. Od czerwca 2017 mieszka w Berlinie. Po ukończeniu doktoratu na elitarnym paryskim Uniwersytecie Sciences-Po pracowała jako politolog i ekspert w organizacjach pozarządowych ds. współpracy rozwojowej, budowania pokoju i dyplomacji publicznej. Obecnie uczy się niemieckiego i pracuje jako wolontariusz w amerykańskiej organizacji pozarządowej, która zmienia młodych ludzi w ambasadorów pokoju.

Byłeś tam przez trzy miesiące - wystarczająco długo, aby zobaczyć wszystko, co możesz sobie wyobrazić?

Jesteś w samym środku tego bardzo szybko. Myślę, że teraz bardzo dobrze znam otchłanie, które rozgrywają się na Facebooku. Ale nie musiałem edytować wideo na żywo i oczywiście są rzeczy specyficzne dla danego kraju. Byłem odpowiedzialny za artykuły w języku tureckim.

Czy żałujesz przyjęcia dzisiejszego stanowiska?

Nie przejdzie bez śladu i nie jest łatwo to zostawić. Ale nie żałuję, bo odkryłem zupełnie nowy świat. Dużo się nauczyłem. Zmienia cię, ale pomaga lepiej zrozumieć, kim jesteś i jak funkcjonujesz. Ale nie było też żadnych działań następczych do konkluzji. List otwarty opublikowany przez „Süddeutsche Zeitung” jest częścią mojej ponownej oceny. Postanowiłem upublicznić to, aby zwrócić na siebie uwagę.

Czy to cię zmieniło i przestraszyło?

Już w tym czasie. Kiedy widzisz to każdego dnia, stajesz się o wiele bardziej czujny w życiu codziennym i zmieniasz swój pogląd na społeczeństwo. Nie było ani jednej treści, która byłaby szczególnie zła i szokowała mnie przez długi czas, w tym niektóre, w tym znęcanie się nad dziećmi. W pewnym momencie nie czujesz, że filmy z dekapitacją są tak złe, bo trochę krwi płynie i nie widzisz długiego cierpienia. Kiedy nie możesz pomóc, ale rozwijasz empatię, jest to najtrudniejsze do zrobienia. Obrazy pełne krwi, okaleczonych i rozdartych ciał to czysty horror, ale właśnie wtedy nauczyłam się przezwyciężać wstręt. Przede wszystkim masa, stały przepływ.

Czy nauczyłeś się, jak źli mogą być ludzie?

Zasmuciło mnie to, zwłaszcza gdy w okropnej treści nie było żadnego sensu. W wielu przedstawieniach przemocy konflikty społeczne znajdują odzwierciedlenie również w cyfrowym świecie. Możesz wyjaśnić, dlaczego coś takiego się rozprzestrzenia. Ale jeśli nie wiesz, dlaczego ktoś powinien to widzieć, dlaczego ktoś to rozpowszechnia, to jest niepokojące. Na moich poprzednich stanowiskach w pomocy humanitarnej widziałem przemoc i cierpienie na świecie. Różnica polega na tym, że media społecznościowe są wszędzie. To mnie bardziej martwi, po prostu tego nie rozumiem. I myślę, że inni też powinni wiedzieć, co się tam dzieje.

Czy to też twoja wiadomość?

Tak, społeczeństwo powinno być o tym poinformowane. Facebook nie ponosi odpowiedzialności za treść, wszyscy jesteśmy w jakiś sposób.

Chcesz wzbudzić świadomość i zrozumienie dla moderatorów treści?

Tak, chciałbym również oddać głos dużej armii moderatorów treści. Myślę, że praca moderatorów treści jest bardzo ważna i wymaga uznania. Moderatorzy treści powinni być traktowani jako osobny zawód w mediach społecznościowych. To nie tylko inżynierowie komputerowi, ale także praca, dla której ważni są socjolodzy i osoby z podobnym doświadczeniem. Ta praca, która jest tam wykonywana, ma ogromne znaczenie dla naszego systemu społecznego.

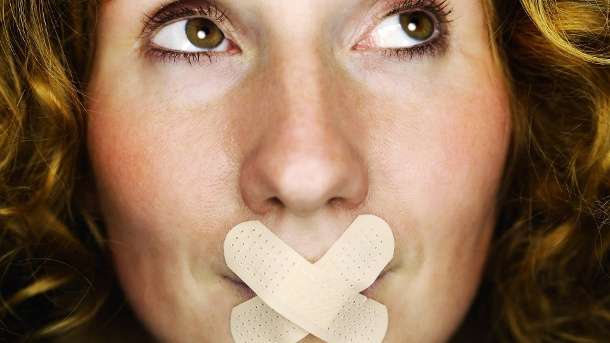

Proszę milczeć: pracownicy zespołu Facebooka ds. usuwania rozmawiali z opinią publiczną tylko anonimowo lub pod nadzorem. (Źródło: obrazy imago)

Czy moderatorzy też tak się czują?

Tamtejsi ludzie czują wielką odpowiedzialność, a ja czułem to samo. Chodzi o ochronę. Możesz to zobaczyć, jest tam, ale zapobiegasz temu, by inni musieli to widzieć. Robiąc to, stawiasz za sobą własną samoobronę. To może być niebezpieczne. Problem w tym, że nie możesz o tym rozmawiać z kolegami – również z powodu braku czasu. Podczas treningu panowała świetna atmosfera w zespole bardzo różnych ludzi, to był wspaniały czas. Ale kiedy jesteś w pracy, to już prawie koniec. Czasu jest mało. W pracy trudno też normalnie sobie radzić. Taka jest natura tej pracy. W autobusie po pracy część z nich rozmawiała ze mną po angielsku, może dlatego, że jestem trochę starsza i pytała, czy mogłabym im doradzić. Zdarzały się przypadki, w których naprawdę można było uratować życie, ale koledzy byli również świadkami samobójstw podczas nagrań na żywo. To bardzo niepokojące.

Czy jest to praca, którą ludzie chcą wykonywać dłużej? Czy możesz wytrzymać?

To jest trudne. Ale to też nie jest prawdziwa praca, a także nowa dziedzina. Wiele osób na całym świecie prawdopodobnie wykonuje tę pracę w znacznie gorszych warunkach niż tutaj w Niemczech, bez ubezpieczenia społecznego, nawiasem mówiąc po angielsku. Ale poznałem tu też ludzi, którzy mówili, że nigdy nie chcą mieć dzieci. Byli tak zszokowani tym, co zobaczyli.

Są to osoby, które po wyjeździe potrzebowałyby dodatkowej pracy, którą przegapiłeś…

Można było przeczytać o przypadkach zespołu stresu pourazowego. Jesteś też przygotowany i przeszkolony do pracy i nadzorowany, ale potem... Pomóc może bardziej ukierunkowany dobór pracowników. Wcześniej pracowałem również w dziedzinie pomocy humanitarnej podczas kryzysu syryjskiego. Widziałem już przemoc i cierpienie. Z pewnością nie jest to łatwe dla osób z mniejszym doświadczeniem życiowym. W zespołach jest dużo różnorodności, ale ludzie są w większości młodzi. Średnia wieku to 28, może 25 lat.

Burcu Gültekin-Punsmann podczas wywiadu z Larsem Wienandem. (Źródło: Marc Krüger)

A wywiady trwają piętnaście minut?

Tak, szybko się skończą. Ale personel jest potrzebny, potrzeba jest wielka. W rozmowach mogą też zasiadać psychologowie. Nie zauważyłem, że po kilku dniach ludzie nie mogli już tego znieść. Ale byli ludzie, którzy często chorowali. A ludzie boją się tego, co zobaczą.

Czy można w tym czasie dowiedzieć się, czy ktoś jako moderator chce usunąć celowo motywowane politycznie?

Myślę, że to nie jest problem. Nie pracujesz w próżni, jest kontrola jakości. Każdy, kto postępuje w ten sposób, szybko przyciągnie uwagę. Być może to jeden z powodów, dla których tak ważne są jasne zasady.

Wielu użytkowników również błędnie lub celowo zgłasza niepoprawne treści, aby uciszyć innych.

To prawda. Widać, że jest zorganizowane raportowanie, że są tematy, na które jest mnóstwo raportów. Byłoby dobrze, gdyby instrukcje były jaśniejsze, a zasady lepiej przekazywane użytkownikom. Wtedy może byłoby o wiele mniej obraźliwych raportów.

Czy czasami czujesz się bezradny jako moderator, na przykład, gdy ludzie są celowo zastraszani?

Właśnie usłyszałem o Australijce Dolly, która odebrała sobie życie za prześladowanie w sieci społecznościowej. Mam córkę, to mnie przeraża. Z mojego doświadczenia wynika, że zasady dotyczące bullyingu są bardzo spójne. Ale pracowałem również w edukacji i czasami czułem potrzebę osobistego wyjaśnienia użytkownikom tego, co robią. Ale to zupełnie nie wchodzi w rachubę. Nie widzimy nawet nazwiska osoby, która to publikuje. Ale czasami dobrze byłoby nawiązać bezpośrednią interakcję z tą osobą.

Ale czasu jest mało. Z okropnym zdjęciem lub filmem możesz przynajmniej szybko skończyć i zyskać sekundy?

Nawet jeśli decyzja jest jasna, że należy ją usunąć, często należy wziąć pod uwagę inne aspekty. Może być kilka powodów, dla których coś zostało usunięte. To może być marginalny aspekt obrazu lub wideo, ale jako moderator treści musisz również zwrócić na to uwagę. Nie mogę być bardziej szczegółowy, ale to nie jest tak, że po prostu naciskasz przycisk. Ale zdarza się, że znasz już materiał, ponieważ jest on rozpowszechniony. Znajdujesz sposoby na szybkość.

Czy usunięcie może zapobiec normalizacji przemocy i zastraszania w mediach społecznościowych?

Mam wątpliwości, to nie wystarczy. Nie wystarczy po prostu pracować na poziomie wirtualnym i wysyłać standardowe wiadomości o „naruszeniu standardów społeczności”, a następnie w pewnym momencie kogoś zbanować. Wróciłem z dziewczyną, która odebrała sobie życie za znęcanie się. Każdy, kto pisze takie wiadomości, powinien wiedzieć, że może to mieć bardzo bezpośrednie, straszne konsekwencje. Rodzice zaprosili stalkerów na pogrzeb. Wtedy staje się jasne, że to nie jest gra. Upubliczniłem też coś takiego, żeby coś takiego było jasne.

Samo usuwanie i odwoływanie się do reguł nie rozwiązuje podstawowego problemu, mówi Burcu Gültekin-Punsmann. (Źródło: obrazy imago)

Czy myślisz, że ludzie mają jedną stronę w mediach społecznościowych i drugą w prawdziwym życiu?

Byłoby źle, gdyby osoba z mediów społecznościowych pokazała prawdziwą stronę. Mało kto powiedziałby po prostu „Jesteś taki brzydki!” do nieznajomego w autobusie. rzucić w głowę. Widać to cały czas na platformie. I widać, jak niektórzy ludzie pokazują się na Facebooku zupełnie bezwstydnie i myślą, że to nie jest publiczne. Ale są widoczne. Czasami chodzi o narcyzm, ludzie chcą lajków za wszelką cenę. Jeśli rzeczywiście istnieje sposób, aby tacy ludzie zostali celebrytami na Instagramie i zarabiali na tym pieniądze, czułbym się lepiej. Wtedy przynajmniej kryłoby się za tym coś racjonalnego.

Zastanawiali się, czy to, co robią, to cenzura.

Zadałem sobie to wcześniej. Czytałem teksty krytyczne. Ale nie, to nie było cenzurowanie. Chodzi głównie o konkretne zachowanie, mniej o opinię. Mogę rozmawiać o swoich zadaniach z treściami w języku tureckim. Było też dużo, nazywam to kreatywnością, by wypowiadać się w kwestiach politycznych, na czele państwa czy w sprawach religijnych, a nawet jeśli ktoś osobiście został odepchnięty, to bardzo poważnie traktowałem prawo do wolności wypowiedzi. To jest teraz problem w Niemczech. Nie wiem czy powinienem komentować prawo...

Tak proszę! Masz na myśli ustawę Network Enforcement Act, która obowiązuje od początku roku, która ma na celu zachęcenie platform do bardziej konsekwentnego ścigania nielegalnych treści.

Mowa nienawiści to poważny problem, a wpisy szerzące nienawiść mogą mieć wpływ na życie ludzi. Zajmowałem się tym wcześniej. W Niemczech sytuacja prawna jest bardzo surowa. Nie śledziłem tego zbyt często, dopóki mój list nie został z nim połączony po publikacji. Obawiam się, że będzie to precedens dla przepisów dotyczących platform mediów społecznościowych w krajach autorytarnych, w których homoseksualizm, bluźnierstwo lub krytykowanie rządu są przestępstwem. Oddzielone od mowy nienawiści, często istnieją różne definicje tego, co jest przestępcze, a co nielegalne. Platformy mediów społecznościowych mają charakter globalny, a ograniczenia krajowe są trudne. A zasady mowy nienawiści są w moich oczach dobre.

Ale?

Jak podkreślają standardy społeczności, mowa nienawiści na platformie nie jest tolerowana. Wyzwaniem jest w rzeczywistości usunięcie naruszeń z platformy tak szybko, jak to możliwe w ciągu 24 godzin. Miałem przetwarzać 1300 raportów dziennie. Słyszałem, że tygodniowo jest 6,5 miliona raportów.

Powinno więc być pomocne, jeśli sieci muszą zapewnić przejrzystość, jak dobrze wdrażane są zasady?

Prawo zmusza platformy mediów społecznościowych do zapewnienia większej jasności co do ich zasad. Jest to mile widziane, jeśli trzeba upublicznić obsługę przepisów, ponieważ otwiera to dyskusje na temat tej pracy. Ale mowa nienawiści to nie tylko problem niemiecki, to problem globalny, a w mediach społecznościowych nie ma granic narodowych. Jak widać ode mnie, moderacja odbywa się w wielu językach w Niemczech. I nie tylko ci, którzy pracują dla Niemiec, powinni skorzystać. W przeciwnym razie mamy duży, bardzo profesjonalny, dobrze opłacany niemiecki zespół, ale ulepszenia nie wpłyną na inne zespoły, które są odpowiedzialne na przykład za treść turecką, arabską lub rosyjską.

Źródła i materiały dodatkowe: - List otwarty od Burcu Gültekin Bunsmann w "SZ" - Standardy społeczności Facebooka - "Spiegel online" - Artykuł o wycieczce z przewodnikiem po centrum gaśniczym